В четвъртък Stability AI представи Stable Diffusion 3 – най-новата версия на своя модел за генериране на изображения от текст.

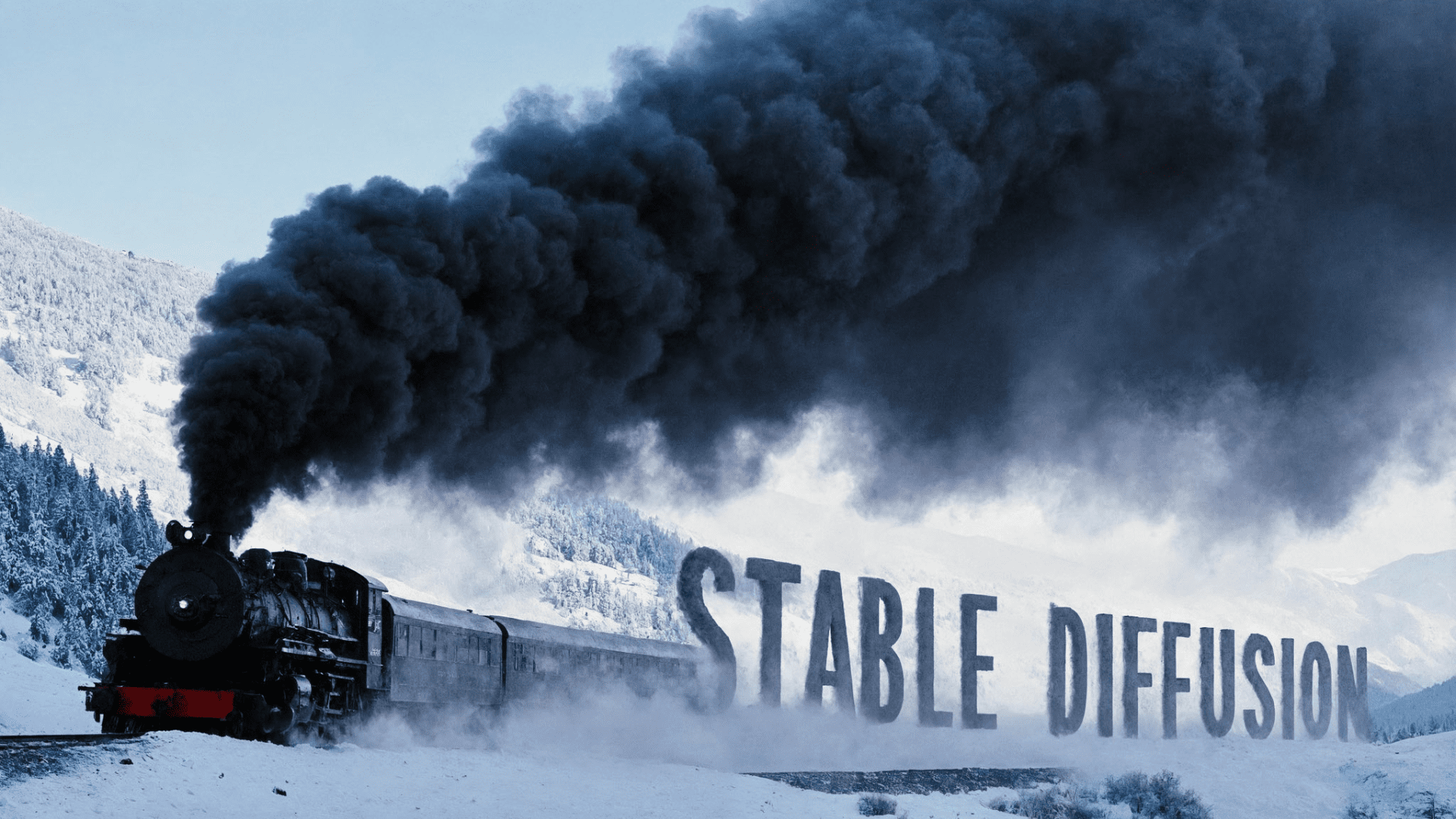

Announcing Stable Diffusion 3, our most capable text-to-image model, utilizing a diffusion transformer architecture for greatly improved performance in multi-subject prompts, image quality, and spelling abilities.

— Stability AI (@StabilityAI) February 22, 2024

Today, we are opening the waitlist for early preview. This phase… pic.twitter.com/FRn4ofC57s

Базираната в Лондон компания разработва AI модели за генериране на изображения от 2022 г. насам. Те се утвърдиха като по-отворена алтернатива на модели като DALL-E 3 на OpenAI. Моделите на Stable Diffusion могат да се изпълняват локално и да се настройват за различни цели.

От компанията отбелязват, че новият модел, който все още не е широко достъпен, генерира изображения с по-добро качество, работи по-добре с указания, свързани с множество обекти, и може да генерира по-прецизен текст – нещо, с което предишните модели на Stable Diffusion не се справяха добре.

Stability също така поясни, че „фамилията от модели Stable Diffusion 3 варират от 800 милиона до осем милиарда параметри, осигурявайки на потребителите разнообразни възможности за мащабиране и качество“.

Главният изпълнителен директор на компанията, Емад Мостаке, написа в X, че моделът използва архитектура, подобна на Sora (новият модел за видео на OpenAI), и добави, че приема мултимодални входни данни.

Some notes:

— Emad (@EMostaque) February 22, 2024

– This uses a new type of diffusion transformer (similar to Sora) combined with flow matching and other improvements.

– This takes advantage of transformer improvements & can not only scale further but accept multimodal inputs..

– More technical details soon

През последните няколко месеца Stability AI пусна редица модели, включително за генериране на изображения, аудио, видео, 3D и код. Преди броени дни компанията представи Stable Cascade – нов модел за генериране на изображения от текст, базиран на нова архитектура.

Stable Cascade is now available in research preview for non-commercial use. This innovative text to image model introduces a three-stage approach, featuring enhancements for fine-tuning and training efficiency with a focus on further eliminating hardware barriers.

— Stability AI (@StabilityAI) February 13, 2024

Learn more… pic.twitter.com/4sLHoQJtje

Последвайте ни в социалните мрежи – Facebook, Instagram, X и LinkedIn!