Отвореното писмо, озаглавено „Прекъсване на веригата за доставки на дълбоки фалшификати“ (Disrupting the Deepfake Supply Chain), беше подписано от над 800 видни учени и специалисти по изкуствен интелект, като Йошуа Бенгио, Стюарт Ръсел, Дан Хендрикс, както и от изследователи от Google DeepMind и OpenAI.

Подписалите призовават за по-строго регулиране на „дълбоките фалшификати“ (deepfakes), които имитират хора, и които те описват като „неподходящи или грубо подвеждащи гласове, изображения или видеоклипове, генерирани от изкуствен интелект, които разумен човек би приел за истински“.

Дълбоките фалшификати представляват нарастваща заплаха за обществото и правителствата трябва да наложат задължения по цялата верига на доставки, за да спрат разпространението на дълбоките фалшификати.

Новите закони трябва:

- Напълно да криминализират детската порнография с дълбоки фалшификати, дори когато са изобразени само измислени деца;

- Да въведат наказателни санкции за всеки, който съзнателно създава или съзнателно улеснява разпространението на вредни дълбоки фалшификати;

- Да изискват от разработчиците и разпространителите на софтуер да предотвратяват създаването на вредни дълбоки фалшификати чрез своите аудио- и визуални продукти и да носят отговорност, ако превантивните им мерки са твърде лесно заобиколени.

- Ако бъдат разработени разумно, тези закони биха могли да насърчат социално отговорния бизнес.

Тъй като изкуственият интелект напредва бързо и прави създаването на дълбоки фалшификати много по-лесно, са необходими предпазни мерки за функционирането и интегритета на нашата дигитална инфраструктура

– предупреждават изследователите.

През 2024 г. изображенията и гласовете, генерирани от изкуствен интелект, вече не могат да бъдат различени от истинските. Тази година големият акцент е върху генерирането на видео, което вече изживява своя „GPT момент“ с модела Sora от OpenAI.

Open AI just released SORA. This is a clip from their site.

— Aze Λlter. (@AzeAlter) February 15, 2024

This new AI text to video is going to change EVERYTHING.

Prompt: A young man at his 20s is sitting on a piece of cloud in the sky, reading a book. pic.twitter.com/VL63laWwhl

WOW – the fidelity on Sora's dog videos is out of this world pic.twitter.com/gVJ7PAEdpj

— Pico Paco, e/λ (@PicoPaco17) February 20, 2024

Това несъмнено ще доведе до раздвижване в областта на генеративното видео. Има информация, че Adobe, Google, Runway и Midjourney и др. също работят по видео модели от следващо поколение.

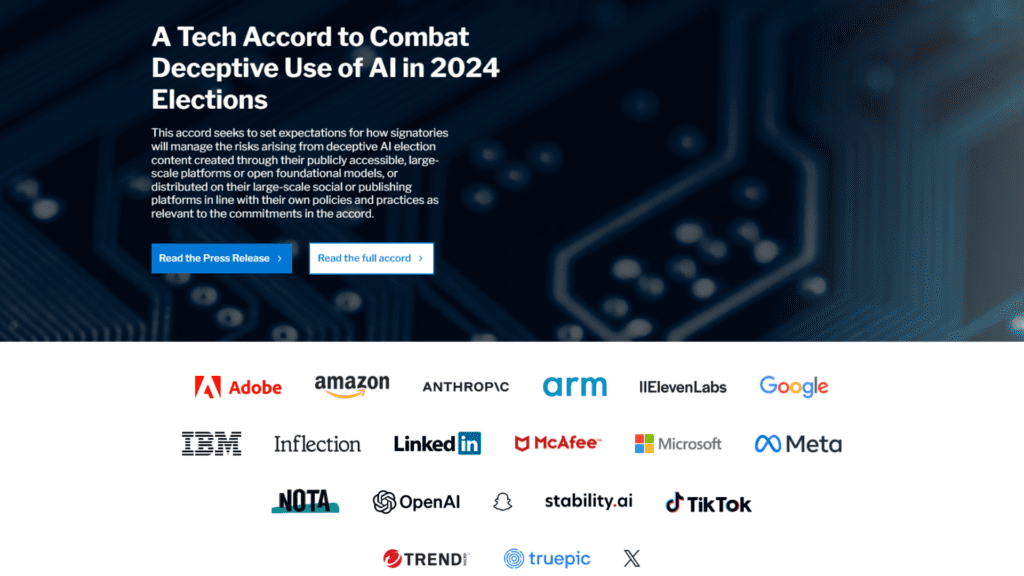

Във връзка с това, миналата седмица двадесет от водещите технологични компании, сред които Google, Meta, Microsoft, OpenAI, TikTok, X, Amazon и Adobe, обещаха да предприемат действия срещу разпространението на дезинформация чрез изкуствен интелект по време на тазгодишните избори.

Споразумението включва конкретни ангажименти, които компаниите ще поемат за разработване на технологии за откриване и намаляване на рисковете, свързани със заблуждаващо съдържание с изкуствен интелект, както и за откриване и справяне с такова съдържание в различните платформи.

Последвайте ни в социалните мрежи – Facebook, Instagram, X и LinkedIn!